정보 엔트로피

What I Learned

- 정보 엔트로피는 무엇인지에 대해 개괄적으로 학습했다.

0) 개요

- 필자는 정보이론에 관한 내용을 본격적으로 학습한 것이 아닌, 문서 열람 중 엔트로피 디코딩에 관한 내용을 탐색하다 본 내용을 함께 정리하게 된 것이다. 따라서 탐색한 자료를 읽고 이해한 내용을 정리하였기에, 100% 정확하지 않음을 인지하고 읽기를 권한다.

- 비트 단위를 쓸 때는 $log~2$와 같이 로그의 밑을 2로 둔다. 이 글에서 $log$는 모두 $log~2$를 뜻한다.

1) 정보량

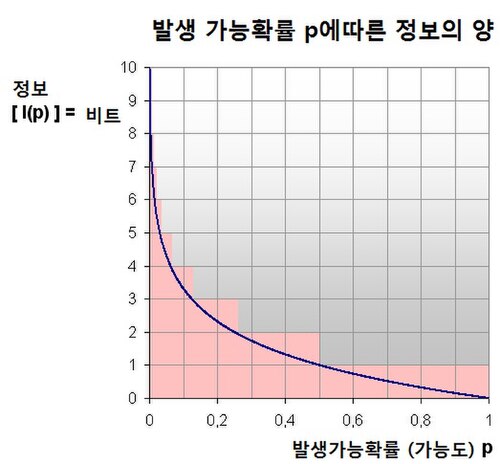

- 어떤 사건 A가 발생했고, A의 발생 확률이 매우 높았을 경우, 그 사건의 발생은 그리 놀랍지 않을 것이다.

- 반대로 어떤 사건 A’가 발생했고, A’의 발생 확률이 낮아 발생 여부가 불확실했다면, 그 사건의 발생은 A에 비해 놀라울 것이다.

- 상술한 부분에서의 ‘놀라움’ 을 ‘정보량’ 으로 보면, 사건 A는 정보량이 낮다고 하 수 있고, A’는 정보량이 높다고 할 수 있다.

즉, 정보량은 (발생)확률에 반비례한다.

2) 정보 엔트로피

- 여러 사건들이 발생하는 상황을 가정하면, 엔트로피 값은 어떤 사건이 발생했을 경우 얻을 것으로 기대되는 평균 정보량을 측정하여 매기게 된다.

- 즉, 정보 엔트로피는 ‘어떤 상태에서의 불확실성’, 또는 이와 동등한 의미로 ‘평균 정보량’을 의미하는 것이다.

- 참고로 엔트로피라는 명칭이 붙은 이유는, 후술할 섀넌의 정보이론에 등장하는 개념이 열역학적 엔트로피 개념의 확장이라 할 수 있기 때문이다.

3) 섀넌의 정보이론

-

1948년 벨 연구소의 클로드 섀넌Claude Shannon이 발표한, “A mathematical theory of communication” 이라는 논문에는 Entropy라는 물리량이 제시되었다.

-

Entropy:

- 2가지 가능성을 지닌 무작위 변수 $X$의 불확실성을 수치화해보면:

- $X=0$일 확률이 $p$이고 $X=1$ 일 확률이 $1-p$인 경우,

$H(X)=-plogp-(1-p)log(1-p)$는 $X$의 불확실성을 측정하는 하나의 물리량이 된다. - $p=0 or p=1$인 경우, $H(X)=0$으로 불확실성이 없어지고, $p=0.5$인 경우, $H(X)=1[bit]$로 한 번의 질문이 필요한 불확실성이 생긴다.

- 무작위 변수 $X$의 정보량 $H(X)$는 사실인 정보의 합, 분리를 우리의 상식과 일치하도록 정의하는 유일한 선택이라고 할 수 있다.

- 두 가지 이상의 사건을 다루는 무작위 변수 $X$에 대한 엔트로피는 다음과 같이 일반화할 수 있다:

- $X=0$일 확률이 $p$이고 $X=1$ 일 확률이 $1-p$인 경우,

- 2가지 가능성을 지닌 무작위 변수 $X$의 불확실성을 수치화해보면:

$$

H(X) = - \sum_x p(x)\log p(x) = \mathbb{E}\left[\log \frac{1}{p(x)}\right]

$$

- 위 식에서 $log(1/p(x))$은 사건 $x$가 발생한 경우 얻는 정보량으로 해석할 수 있다. 확률 $p(x)$가 큰 사건의 경우에는 상술한 정보량의 의미에 따라 발생 시 얻는 정보의 양이 적을 것이고, 반대로 확률 $p(x)$가 작은 사건의 경우에는 발생 시 얻는 정보의 양이 많을 것이다.

Key Concepts

- 정보 엔트로피의 정의와 개념

p.s.

해당 학문에 대한 이론적 조예가 아직 깊지 않아, 정보이론에 대해 더 배워야 할 듯하다.

References

- https://ko.wikipedia.org/wiki/%EC%A0%95%EB%B3%B4_%EC%97%94%ED%8A%B8%EB%A1%9C%ED%94%BC

- https://horizon.kias.re.kr/18474/